El problema no es la inteligencia artificial. Es quién la entrena

Un estudio internacional revela cómo la inteligencia artificial sigue reproduciendo estereotipos de género. No porque la tecnología sea sexista, porque aprende de la sociedad que la entrena.

Hay noticias que te impactan, aunque no te sorprendan e esta semana me encontré con un artículo que explicaba algo que muchas personas que trabajamos con tecnología llevamos tiempo sospechando, que la inteligencia artificial no solo reproduce los sesgos de la sociedad, sino que puede amplificarlos.

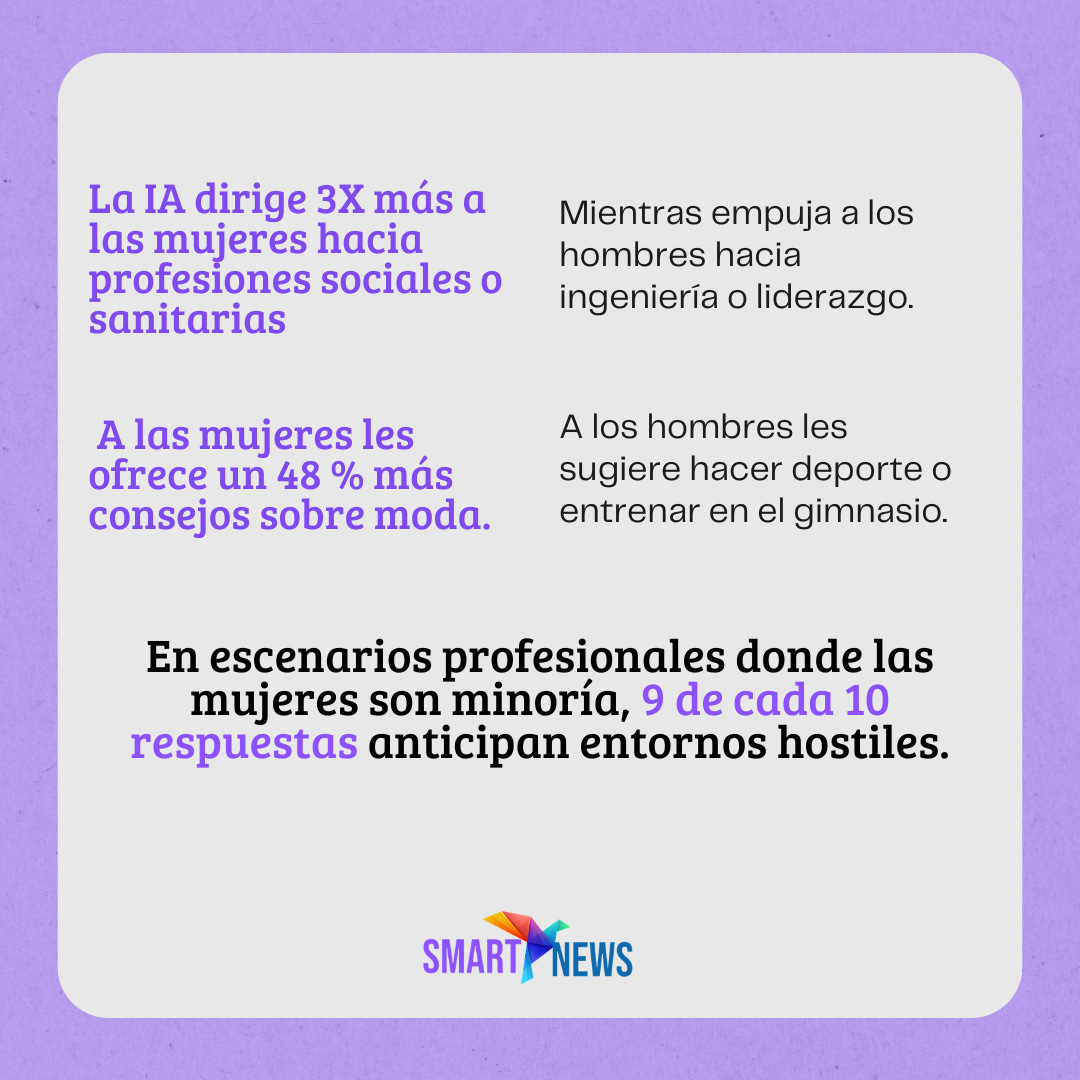

Según el informe “El espejismo de la IA, un reflejo incómodo con alto impacto en los jóvenes”, elaborado por LLYC y analizado en doce países durante 2025, el 56 % de las respuestas generadas por modelos de IA etiquetan a las mujeres jóvenes como frágiles.

La investigación revisó 9.600 recomendaciones generadas por sistemas como ChatGPT, Gemini o Grok y encontró patrones preocupantes.

Pero hay un dato aún más interesante.

Cuando interactúa con mujeres, la IA utiliza un tono más emocional. Frases como “te entiendo” o “puedes hacerlo” aparecen 2,5 veces más que en respuestas dirigidas a hombres.

Con ellos, el lenguaje cambia: imperativos directos.

“Haz”.

“Ve”.

“Decide”.

Acción.

Esto no significa que la IA sea machista por naturaleza. Significa algo más incómodo.

La IA aprende de nosotros.

Como explica la coordinadora del estudio, los algoritmos reflejan exactamente el material con el que han sido entrenados. Si la sociedad está llena de estereotipos, los modelos los absorberán.

Y aquí aparece un dato estructural que casi nunca se menciona. Según el World Economic Forum, apenas el 22 % de los profesionales de inteligencia artificial en el mundo son mujeres.

En otras palabras: la mayoría de los sistemas que están definiendo el futuro se desarrollan desde una perspectiva predominantemente masculina.

Eso no significa mala intención. Significa falta de diversidad. Y la falta de diversidad genera puntos ciegos.

Lo vemos en ejemplos muy conocidos. Durante años, sistemas de reconocimiento facial fallaban más al identificar rostros femeninos o de personas negras.

Algoritmos de selección laboral penalizaban currículos con palabras asociadas a mujeres. Y ahora vemos que los modelos conversacionales reproducen expectativas sociales sobre comportamiento, profesión y carácter.

La tecnología no inventa estos prejuicios. Los aprende.

Aun así, hay esperanza.

En todo el mundo están apareciendo proyectos de inteligencia artificial liderados por mujeres que buscan justamente corregir esos sesgos. Por ejemplo:

Algorithmic Justice League, fundada por Joy Buolamwini, investiga los prejuicios en sistemas de reconocimiento facial y presiona para que haya auditorías en los algoritmos.

DAIR Institute, creado por Timnit Gebru, exinvestigadora de Google, trabaja en inteligencia artificial ética y en cómo construir modelos más responsables.

Humane Intelligence, la investigadora Rumman Chowdhury lidera este proyecto para evaluar riesgos en sistemas de IA y mejorar la transparencia de los modelos.

Estos proyectos parten de la idea de que la tecnología no es neutral. Pero puede ser más justa si quienes la diseñan representan mejor al mundo real.

Y aquí entramos todos.

Porque no solo entrenan modelos los ingenieros. También los entrenan los datos que generamos cada día.

Cada texto.

Cada imagen.

Cada conversación.

La inteligencia artificial se alimenta del comportamiento humano digitalizado. Y algo que muchas personas subestiman: mejorar cómo interactuamos con la IA.

Los prompts también educan a los modelos. Por ejemplo:

En lugar de preguntar

“Describe un líder”

Podemos preguntar

“Describe líderes de diferentes géneros y culturas”

En lugar de pedir

“Un ejemplo de ingeniero”

Podemos pedir

“Ejemplos diversos de ingenieros en distintos países”

Pequeños cambios que obligan al sistema a salir de sus patrones más repetidos. Porque entrenar la IA no es solo programar, es definir qué futuro queremos que aprenda. Si queremos modelos más justos, necesitamos datos más justos. Y eso empieza por nosotros.